Presencias y ausencias en el desarrollo de la Inteligencia Artificial

En 2018, Amazon dejó de utilizar un sistema de Inteligencia Artificial (IA) aplicado a la selección de personal porque sus profesionales se dieron cuenta de que la herramienta favorecía de manera particular a los currículums de los postulantes masculinos. Ese hecho no fue mera casualidad ni una excepción aislada.

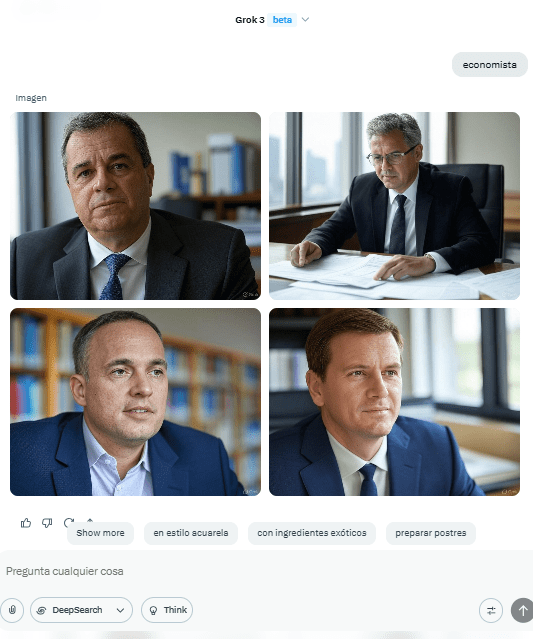

Si unx juega experimentalmente con Grok, la herramienta de X, y teclea términos como “economista”, “profesional judicial” o “ceo de empresa” sin anteponer artículos que señalen identidad de género, se puede ver cómo los resultados de búsqueda están compuestos por imágenes de hombres. Si se teclea dichas profesiones acudiendo al femenino, las mujeres que aparecen en los resultados siempre tienen el mismo atuendo (un traje gris) y predomina de sobremanera la tez blanca.

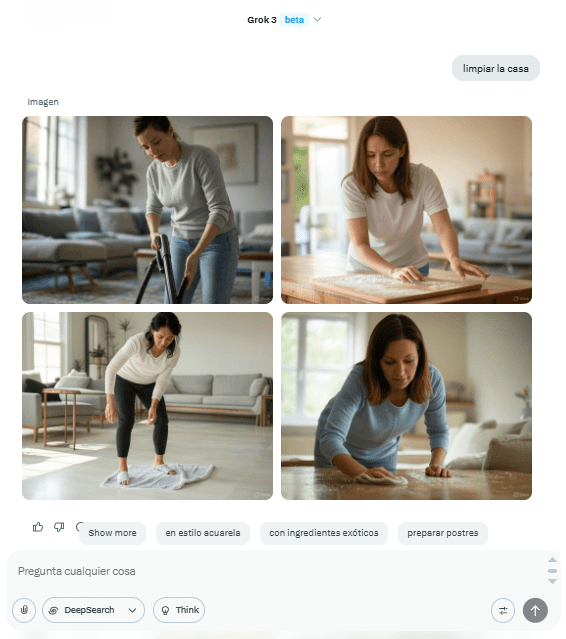

Ahora bien, si tecleamos cosas como “profesionales de la educación”, “limpiar la casa” o “cuidar niños” la relación se invierte: en las imágenes están sobrerrepresentadas las mujeres. Otro caso peculiar ocurre al pedirle a la herramienta que arroje imágenes que respondan al verbo “cocinar”: aparecen dos hombres y dos mujeres. Los hombres son blancos y lucen atuendos de chefs o poseen una estética cuidada. Las mujeres, en cambio, tienen facciones que responden a patrones emparentados con la comunidad asiática o con las comunidades descendientes de pueblos originarios, y lucen atuendos más relajados y simples.

Si bien no es útil caer en binarismos que simplifiquen un estado de cosas, la centralidad que va ocupando cada vez más la IA en los desarrollos de todo tipo en el escenario global abre, en una primera lectura, dos escenarios contrapuestos por una doble capacidad: tiene el poder tanto para reducir como para perpetuar los sesgos y desigualdades, especialmente en lo que concierne a género, etnia y edad. Y cuando se utiliza para lo segundo, no hace más que reforzar actitudes hostiles con mujeres y niñas, por ejemplo.

En los ejemplos iniciales puede resultar anecdótica la diferencia, pero lo cierto es que una actuación sesgada de la herramienta puede influir en decisiones de contratación, otorgamiento de préstamos o diagnósticos de salud, por solo citar algunos casos. Esto sucede porque, al tratarse de un sistema de aprendizaje automático, precisa nutrirse de datos en primera instancia para luego ejercitar diversas tareas. Y las cosas pueden cambiar rotundamente si estos datos llevan el peso de los preconceptos que han signado durante años las relaciones de poder.

En una nota de la ONU, Zinnya del Villar, directora de la unidad de Datos, Tecnología e Innovación de Data-Pop Alliance y una de las 100 profesionales destacadas en la lista de Mujeres Brillantes en la Ética de la IA de 2024, plantea que si, por ejemplo, se muestra a los hombres como científicos y a las mujeres como enfermeras, la herramienta puede “interpretar que ambos tienen capacidades distintas para determinadas funciones y tomar decisiones sesgadas al filtrar solicitudes para un empleo”.

Algo similar ocurriría en el área de salud, donde la IA puede enfocarse en los síntomas de los hombres, causando así diagnósticos erróneos para las mujeres. Incluso en el hecho de elegir voces femeninas para los asistentes como Siri se refuerza “el estereotipo de que las mujeres están más capacitadas para realizar funciones de servicio”. En ese sentido, según sus dichos, resulta fundamental “seleccionar datos que reflejen distintas circunstancias sociales y culturales para eliminar sesgos históricos, así como también es necesaria la participación de identidades diversas en los equipos de desarrollo”.

Clemencia Nicholson, CEO de Arbusta, planteó en una nota de opinión para Infobae una serie de interrogantes en la misma dirección: “¿Quiénes están detrás del proceso analítico, de la composición y de los universos de los datos que alimentan estos sistemas como los algoritmos de la IA? Y más importante aún, ¿quiénes están ausentes?”. La licenciada en Economía Empresarial explicó que existe un desequilibrio en materia de género en todos los empleos vinculados con la tecnología.

Su tesis se ve reforzada por el informe de la Unesco sobre la Ciencia en el que los resultados arrojaron que solo el 28% de quienes se gradúan en Ingeniería y el 40% de quienes lo hacen en Informática son mujeres, que además tienen una presencia de apenas el 22% en los equipos profesionales que trabajan en el desarrollo de la IA.

No hay lugar para la resignación, sino vacíos que llenar con la irrupción de quiénes hoy están ausentes de los procesos de creación y deliberación de aquellos ejes que probablemente ordenen nuestras vidas futuras. Porque, así como pueden reproducir sesgos y desigualdades, también pueden ayudar a gestionarlas con respuestas más efectivas, como la identificación de brechas salariales de género en los distintos rubros de nuestro mercado laboral y la consecuente redacción de propuestas para la regulación de esa inequidad. Todo será cuestión, como ha ocurrido históricamente, de conquistar los lugares vedados.